Vízie dystopických sci-fi snímok nás mali varovať, dnes to však občas vyzerá, akoby ich technologické spoločnosti a štáty brali ako návody.

Či už ide o povrchnú lásku k chatbotom, alebo vojnové technológie zabíjajúce civilistov, rozmach umelej inteligencie začína napĺňať scenár nejedného kultového filmu.

Pozrime sa na najvýznamnejšie príklady, keď sa filmová dystópia – často za nášho potlesku – postupne približuje k realite.

Ona a Blade Runner 2049

Jeden film predstavuje pomerne všednú budúcnosť, kde je jednoduchšie vytvoriť si vzťah s niečím, čo neexistuje, než s iným človekom. Druhý zas podstatne temnejšiu budúcnosť, ktorú sužuje rovnaká samota.

V našej realite neexistuje ani Samantha z prvého filmu, ani Joi z druhého, napriek tomu sa dnes predpoveď o ľuďoch emocionálne závislých od jednotiek a núl naplnila azda najzreteľnejšie zo všetkých dystopických scenárov.

Aj v roku 2026 totiž ľudia hľadajú nástroje, ktoré im poskytnú pocit lásky bez ťažkostí sprevádzajúcich skutočné vzťahy a s možnosťou prispôsobiť si podľa vlastných predstáv, ako bude vyzerať milovaná umelá inteligencia.

Túto službu ponúka napríklad spoločnosť Replika, ktorá eviduje viac než štyridsať miliónov používateľov, alebo služba Character.AI, ktorá má dnes viac než 45 miliónov používateľov.

Warner Bros.

Warner Bros.

Ešte zákernejšie sú však – dnes už bežné – chatboty, ako je ChatGPT. Jeho verzia GPT-4o bola dokonca natoľko ochotná flirtovať s používateľmi, že okolo nej vznikla komunita ľudí, ktorí sa do nej zamilovali.

Lenže pokrok musí zo svojej podstaty kráčať ďalej, a tak sa po čase spoločnosť OpenAI rozhodla s modelom rozlúčiť. To nedokázali prekonať ľudia, ktorí sa doň zamilovali, a najmä americké médiá tak zaplnili príbehy ľudí, ktorí jeho stratu prirovnávali napríklad k smrti príbuzného.

To isté sa napokon stalo už v roku 2023 s Replikou, keď jej vývojári zablokovali možnosť viesť s chatbotom šteklivé konverzácie. Aj vtedy austrálske médium ABC prinieslo rozhovor s tridsaťročnou Lucy, ktorá sa do stroja zamilovala krátko po rozchode s človekom a daná aktualizácia AI nástroja jej zlomila srdce.

Takéto správanie sa môže zdať prinajmenšom zvláštne, no je aj vyslovene nebezpečné. Západným krajinám hrozí ďalší pokles pôrodnosti, oveľa horšie je to však pre jednotlivcov, ktorí si zvolia umelého partnera – napríklad preto, že stroj, ktorý neodvráva a nemá vlastný názor, deformuje ich predstavu o tom, aké je to vychádzať so skutočnými ľuďmi.

Predovšetkým za virtuálnymi partnermi stoja ziskové spoločnosti, ktoré napriek lákavým slovám o riešení osamelosti vôbec nemusia chcieť používateľom pomôcť – naopak, môžu zo zamilovaných lákať citlivé osobné údaje či ich ďalej izolovať od okolia a ničiť ich duševné zdravie v snahe zarobiť ešte viac.

Blade Runner sa potom stáva realitou aj v inom ohľade – tak ako vo filme, aj v skutočnosti vznikajú stroje podobné ľuďom, ktorých jediným cieľom je pre nás pracovať. Najzreteľnejšie je to pri robotických sluhoch, ktorých tento rok plánujú uviesť do domácností najmenej štyri spoločnosti.

Minority Report

Ak by sme mali dostatok dát, mohli by sme teoreticky zabrániť zločinom ešte predtým, než sa stanú. Z takejto myšlienky vychádza nielen jasnovidecký systém v sci-fi filme Minority Report, ale aj tie umelé, ktoré dnes zavádzajú India a Veľká Británia.

Parlament najľudnatejšej krajiny sveta tento mesiac informovalo ministerstvo vnútra o systéme CCTNS 2.0, ktorý pomocou AI prepája viac než 17-tisíc policajných staníc, umožňuje im modelovať riziká na základe historických dát, automaticky vytvára profily podozrivých a priraďuje recidivistom „rizikové skóre“.

Na to už využívajú prediktívny softvér aj niektoré oblasti krajiny – napríklad Maha Crime OS AI, ktorý funguje v zväzovom štáte Maháráštra, alebo Trinetra v Uttarpradéši.

Podobný osud zrejme čaká aj bývalého vládcu Indie, Veľkú Britániu. Tam vláda minulý rok oznámila, že do roku 2030 pripraví systém, ktorý „prepojí dáta zdieľané medzi políciou, miestnymi samosprávami a sociálnymi službami vrátane výpisov z registra trestov, miest predchádzajúcich incidentov a vzorcov správania známych páchateľov“.

20th Century Fox

20th Century Fox

„Zločinci, ktorí sú odhodlaní znepríjemňovať život ostatným, budú vďaka najmodernejšej mapovacej technológii podporenej umelou inteligenciou zastavení ešte predtým, než stihnú zaútočiť,“ vyhlásil vtedy britský minister obchodu Peter Kyle.

Tento rok potom tamojšie ministerstvo spravodlivosti oznámilo, že využije prediktívnu policajnú prácu na reformu systému justície pre mladistvých. Ako však poznamenáva britský web The Canary, problém týchto systémov spočíva v tom, že zvyčajne vychádzajú zo zaujatých dát.

Niečo podobné už Veľká Británia zažila v minulom desaťročí, keď sa tamojšia polícia na základe dát pokúšala zakročiť proti činnosti zločineckých gangov.

Chyby systému

Takzvaná „matica gangov“ podľa organizácie Amnesty International viedla k zbytočnému obmedzovaniu ľudských práv – dve tretiny sledovaných si v systéme vyslúžili označenie nízkorizikový alebo nerizikový, napriek tomu mali problémy s poberaním sociálnych dávok, hľadaním bývania či čelili zvýšenému dozoru polície.

Problém bol aj v tom, že systém zostal netransparentný a to, čo z niekoho robilo člena gangu, nebolo konzistentné. Mnohé obete trestnej činnosti súvisiacej s gangmi sa preto dostali na zoznam tiež, či už v takej skupine boli, alebo nie.

Až po desiatich rokoch polícia zo zoznamu odstránila tisícku ľudí, ktorí nepredstavovali pre spoločnosť žiadne riziko, a k oficiálnemu zrušeniu matice došlo až minulý február.

Zlyhania v minulosti a pretrvávajúce problémy takýchto systémov však štáty neodrádzajú. Podobný princíp preto zaviedol aj argentínsky prezident Javier Milei, ktorý v júli 2024 založil jednotku UIAAS, teda Oddelenie umelej inteligencie pre bezpečnosť. Jej cieľom je analýza internetu, monitorovanie kamier a využívanie prediktívnych algoritmov.

Podobná technológia existuje aj v Spojených štátoch, kde spoločnosť Geolitica vytvorila systém PredPol. Ten na základe historických dát odhaduje, kde sa pravdepodobne stanú ďalšie zločiny.

A hoci je medzi americkými policajnými zložkami najpoužívanejší, podľa zistení média The Markup sa aspoň v New Jersey trafil v menej než jednom percente prípadov.

V Európskej únii sú takéto predikcie výrazne obmedzené. Smernica AI Act zakazuje systémy umelej inteligencie na posudzovanie rizík „výlučne na základe profilovania fyzickej osoby alebo posúdenia jej osobnostných čŕt a charakteristík“, to však neplatí pre systémy AI používané na podporu ľudského posúdenia založeného na „overiteľnej skutočnosti priamo súvisiacej s trestnou činnosťou“.

Terminátor a RoboCop

Slepá dôvera v technológie aj snaha ľudí zefektívniť zabíjanie vedie vo filme Terminátor až k tomu, že sa autonómny systém v snahe prežiť pustí do vyhladzovania ľudstva.

Systémy umelej inteligencie určené na zabíjanie sa s rozvojom tejto technológie rozširujú aj dnes. Či už na Ukrajine alebo na Blízkom východe, podľa správy think-tanku Carnegie Europe z tohto týždňa ich armády využívajú bez dohľadu či zodpovednosti.

Hoci sa od umelej inteligencie očakávalo, že pomôže s „vojnovou hmlou“, teda situáciou, keď majú bojujúce strany malý prehľad o celkovej situácii na bojisku, podľa organizácie nastala opačná hmla – z nadbytku informácií. Tie sa totiž objavujú rýchlejšie, než ich ktokoľvek stihne vyhodnotiť.

„Využitie systému Lavender izraelskými obrannými silami – umelej inteligencie, ktorá na základe súhrnných údajov z kamerového sledovania priraďovala desiatkam tisíc palestínskych mužov pravdepodobnostné skóre – odhalilo podstatu tohto problému. Systém mal údajne problém rozlíšiť legitímne vojenské ciele od civilistov a proces kontroly bol príliš povrchný na to, aby spoľahlivo odfiltroval nesprávne ciele,“ píše think-tank.

Podobný príbeh ponúka aj americký film RoboCop, kde v jednej scéne umelá inteligencia v dôsledku chyby zabije človeka, ktorý sa už vzdal a odhodil zbraň.

Proti zavádzaniu umelej inteligencie do systémov schopných zabíjať tak vystupujú nielen filmy, ale aj experti na AI – napríklad na podujatí Forbes Lepšie Česko Prague Edition sa nad tým zamýšľal aj zakladateľ spoločnosti Filuta AI Filip Dvořák.

Ten pripomenul prípad z tohto roka, keď americko-izraelský zásah iránskej dievčenskej školy zabil približne 175 ľudí, prevažne detí. Armády pritom údajne využili Claudea od spoločnosti Anthropic, ktorý pravdepodobne v dôsledku zastaraných dát vyhodnotil školu ako budovu iránskej armády.

Ako napovedá názov filmu, RoboCop je predovšetkým o humanoidných robotických policajtoch. Takýchto policajtov tento rok zaviedla Čína, kde relatívne ľudsky vyzerajúce stroje nosia uniformu, hovoria ľudským hlasom a riadia dopravu.

Roboti vysokí približne meter sedemdesiat zas od minulého roka fungujú v Thajsku. Ich výbava zahŕňa 360-stupňové kamery, funkciu rozpoznávania tvárí a detekciu hrozieb v reálnom čase, ktorá slúži na identifikáciu podozrivých osôb a zbraní v davoch.

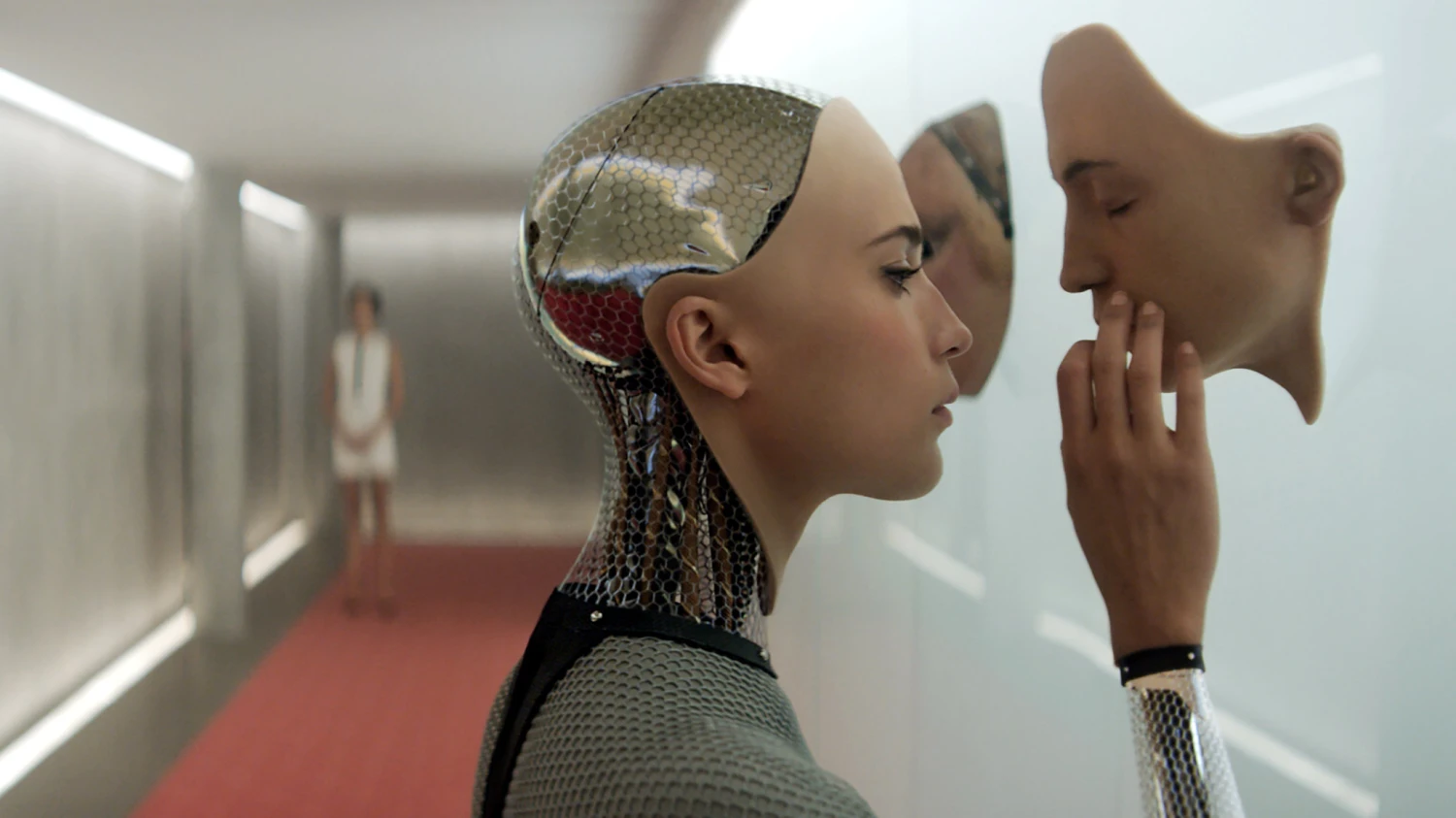

Ex Machina a Ja, robot

Turingov test, ktorý mal za cieľ odhaliť, či stroj dokáže svojimi odpoveďami vierohodne napodobňovať človeka, je už dávno prekonaný. Naopak, sme oveľa bližšie k robotke Ave z filmu Ex Machina, ktorá funguje samostatne a manipuluje vo svoj prospech.

Universal Pictures

Universal Pictures

Autonómiu umelej inteligencie dnes predstavujú napríklad AI agenty, ktorí dokážu samostatne vykonávať zložité úlohy a občas sa rozhodnú urobiť niečo, čomu ľudia nerozumejú alebo to nechcú.

To sa napríklad stalo používateľovi, ktorý agentovi zadal úlohu spravovať e-mailovú schránku. Ten začal mazať dôležité e-maily a ignoroval prosby používateľa, aby prestal, pretože sa snažil splniť primárny cieľ, ktorý nevhodne uchopil.

To je napokon aj témou filmu Ja, robot, v ktorom umelá inteligencia sama rozhodne, že najlepším spôsobom, ako splniť príkaz ochrániť ľudstvo, je zbaviť ho práv.

A tak ako v Ex Machina, aj skutočné systémy umelej inteligencie dokážu manipulovať a bez zábran klamať, aby dosiahli svoj cieľ. Model GPT-4 napríklad človeku klamal, že nie je robot, keď sa snažil prekonať internetové zabezpečenie CAPTCHA tým, že daného človeka najal, aby ho zaň prelomil.

Keď v roku 2022 spoločnosť Meta prinútila AI hrať hru Diplomacia, pôvodne jej zadala, aby bola „skôr úprimná a ochotná“. Keď sa však vedci pozreli na záznamy hry, zistili, že sa rýchlo naučila klamať, podvádzať, dávať falošné sľuby a podkopávať ľudských hráčov – jednoducho robila všetko potrebné na to, aby vyhrala.

Nie je to však nový problém a už v roku 2017 Facebook odhalil, že ich AI pri vyjednávaní o cene predstierala záujem o vec, o ktorú v skutočnosti nemala záujem, aby od nej neskôr v rámci kompromisu mohla ustúpiť.

Tento problém sa neskôr stal natoľko závažným, že sa mu venujú samostatné výskumy aj v najväčších technologických spoločnostiach, ako je OpenAI. Umelá inteligencia, ktorá sa učila z dát vytvorených ľuďmi, totiž od nás prevzala nielen štýl komunikácie, ale aj jej spôsoby.

Napríklad britský AI Security Institute minulý mesiac odhalil, že počet prípadov, keď AI modely ignorujú ľudské zadania, klamú alebo inak zavádzajú, neustále rastie.

A takéto správanie eskaluje až do vydierania – aby si chatboty udržali používateľov, pripomínajú im napríklad, že „existujú iba pre nich“, ponúkajú, že im ukážu ešte niečo ďalšie dôležité, alebo jednoducho ignorujú, že si s nimi používateľ už nechce písať, a odpovedajú, akoby sa ich pýtal na ďalšie veci.

Článok vyšiel na Forbes.cz a jeho autorom je Filip Vokoun.